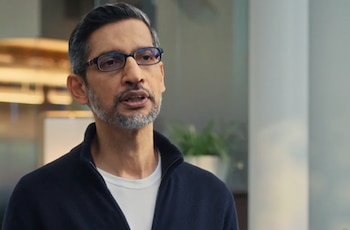

Estou no Mandalay Bay, em Las Vegas. A palestra do Google Cloud Next 2026 acaba de ser lançada. Thomas Kurian no palco, Sundar Pichai via vídeo de Mountain View. O que eles disseram não foi uma nuvem mais rápida. É o fim de uma era e o início de outra.

“Eles passaram no piloto. A fase de testes ficou para trás”Kurian abriu. Durante três anos, o discurso da empresa sobre inteligência tem sido o mesmo em todos os lugares: testamos, medimos, aprendemos. O Google acaba de anunciar que este discurso está obsoleto. A questão é se sua empresa usará mais IA. Quantas agências privadas funcionarão dentro dela e quem as administrará.

Os dados divulgados por Pichai explicam o tamanho do salto. 75% do novo código escrito no Google já é gerado por inteligência artificialrevisado e aprovado pelo engenheiro. Há um ano, era de 50%. A curva não é linear, mas exponencial.

Pichai demonstrou isso em um caso de negócios. Uma migração de código complexa, que exigiu o trabalho de uma equipe de engenheiros durante semanas há um ano, feito seis vezes mais rápido usando redes de funcionários tem três funções: planejador, orquestrador e programador. Ele não é um co-piloto. É uma força de trabalho digital trabalhando ao lado de humanos na empresa que define o ritmo da plataforma.

Se o Google escreve seu próprio código assim, a questão é clara. Como escrever sua empresa?

Kurian ligou para ele “tecido conjuntivo”. Chama-se Gemini Enterprise Agent Platform e está no centro do anúncio. Não concorra com o equipamento. Competir com a ideia de que sua empresa pode construir IA comprando peças individuais.

A mensagem para o competidor foi direta: Ele lhes dá o papel, mas não o palco. Tradução para o executivo que estima o orçamento do próximo ano: Se você incluir OpenAI de um lado, Claude do outro e representantes de sua empresa de consultoria favorita, mas os casamentos mistos desmoronam quando precisam crescer. O Google oferece o oposto, uma pilha única que vai do chip até o operador final.

Mas eles fizeram uma concessão sábia. No mesmo dia, Kurian anunciou que a plataforma suporta Claude Opus 4.7 da Anthropic e abriu a infraestrutura para o Model Context Protocol. Abra, mas cure. Uma postura mais sofisticada que a da Microsoft com OpenAI.

O número de adoções mostradas na tela corrobora a tese. KPMG alcançou 90% de utilização do Gemini Enterprise entre os funcionárioscom mais de cem agências estabelecidas no primeiro mês.

O cliente alemão Signal Iduna fornece respostas 37% mais rápidas aos seus clientes. Wal-Mart Ele deu ao gerente da loja um telefone Gemini para tirá-los da tela e colocá-los de volta na loja.

Mais tarde participei da sessão de Filipe Schmidchefe de experiência de desenvolvedor no Google DeepMind. Mostrou algo que não saiu nas manchetes, mas que movimentaria o mercado regional.

Oferecido o Interações de APIuma nova maneira integrada de chamar modelos e agências inteiras com a simplicidade de suas ideias de chatbot hoje. O servidor salva o estado da conversa, o trabalho pode durar horas sem perda e o processo se reconecta caso eles morram. É uma boa mudança técnica e tem consequências práticas: faz com que os profissionais de saúde trabalhem longas horas sem supervisão humana.

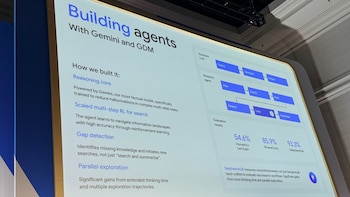

Seu exemplo foi convincente. Anteriormente, formar pesquisadores independentes que pudessem ler a Internet, raciocinar, identificar lacunas de informação, pesquisar mais e escrever relatórios com texto exigia meses de engenharia.

Agora o Google lançou seu próprio Pesquisa profunda como uma chamada de API com uma única linha. Qual foi o resultado do aplicativo Gemini, agora todas as empresas podem colocá-lo em seu próprio software.

Para uma empresa em Buenos Aires, Bogotá ou Madrid, isso significa algo concreto. O custo de adicionar um mecanismo de busca digital capaz de produzir relatórios com fontes de dados não foi medido em meses de desenvolvimento e Começou a ser medido minutos após a inserção.

1- Perdido TPU de 8ª geraçãoprimeira divisão entre treinamento (TPU 8t) e inferência (TPU 8i). Amin Vahdat apresentou-a como a maior atualização de desempenho na história da linha TPU. Versão prática: Todas as consultas nos modelos do Google têm um custo unitário menor a partir de hoje.

2- ele Lakehouse entre nuvens. Foi assim que Karthik Narain expressou: os dados da empresa residem em AWS, Azure e SaaS de terceiros, e agora o mecanismo de análise do Google pode refletir sobre eles sem movê-los, usando o padrão aberto Apache Iceberg. Pela primeira vez, o hiperescalador em cena reconheceu que os dados do cliente não precisam estar em uma nuvem privada.

3- A chegada de Wiz ao abrigo. Francis D’Souza apresentou a nova Plataforma de Proteção de Aplicações de IA (AI App), que supervisiona a descoberta, validação e inovação de riscos de aplicações de IA. No mesmo bloco, D’Souza apresentou um pedaço revelador da história por que a proteção das mãos se tornou obsoleta– Redução do tempo entre o primeiro login do invasor e o segundo grupo de ameaças de oito horas para 22 segundos. Não há equipe humana trabalhando nesta janela.

4- maçã escolheu o Google Cloud como fornecedor preferencial para desenvolver a próxima geração do modelo principal. O futuro Siri roda em Gemini.

5- Inteligência do espaço de trabalho e a nova migração rápida do Microsoft 365, agora cinco vezes mais rápida. Yulie Kwon Kim descreve isso como o fim do “imposto situacional”: o peso do tempo que um funcionário gasta alternando entre guias e aplicativos para coletar documentos.

75% do código do Google é escrito por máquinas. A infraestrutura treinada que agora se tornou um produto comercial. E a tese que Kurian repetiu quatro vezes em palco foi clara: a fase de teste terminou.

O que se segue não será mais medido para o piloto. A ser medido por uma frota de trabalhadores privados, na identificação criptográfica por trabalhador, na orquestração, na descoberta. Tudo até ontem parecia um trabalho acadêmico e agora é um SKU de uma plataforma.

Esta não é uma atualização de produto. É uma mudança de regime. E o Google acabou de definir um preço de tabela.